Reescribiendo el Futuro de AI 2027: ¿Dónde queda América Latina?

Por Elsie Ralston

Nos gusta pensar que el activismo, la filantropía y el trabajo social son antídotos contra la desigualdad, cuando en realidad suelen ser subproductos del mismo sistema que la produce. Lo aprendí recorriendo asentamientos de Perú y el Cono Sur: no es que el poder ignore la pobreza, es que rara vez le importa. Desde esa paradoja me acerqué a AI 2027—un ejercicio de prospectiva dirigido por Daniel Kokotajlo que imagina la irrupción de una IA superhumana antes de que termine esta década. El reporte mezcla datos duros, simulaciones y la colaboración de más de cien expertos para narrar dos finales posibles: Desaceleración (Slowdown) y Carrera (Race). No ofrece recetas, sino un espejo de lo que puede ocurrir si continuamos por inercia.

Mi reacción inicial fue ambivalente: por un lado, el informe describe con crudeza cómo la carrera por la inteligencia artificial podría agravar, en cuestión de pocos años, las disparidades que llevo toda la vida denunciando, incluso llevándonos al resultado más distópico que podríamos imaginar: con super robots de IA exterminando la raza humana; por otro, el documento me devolvió un hilo de esperanza al plantear que aún estamos a tiempo de intervenir, al menos parcialmente. Lo que sigue, es mi intento de traducir ese reporte críptico a un lenguaje más accesible, para acercar el tema a mis colegas estrategas, tecnólogos, políticos, activistas, a la sociedad civil organizada, y a educadores de nuestra región, para ojalá preguntarnos colectivamente qué papel puede jugar América Latina en evitar que la actual gran revolución tecnológica termine sellando un destino distópico.

AI 2027 y su metodología

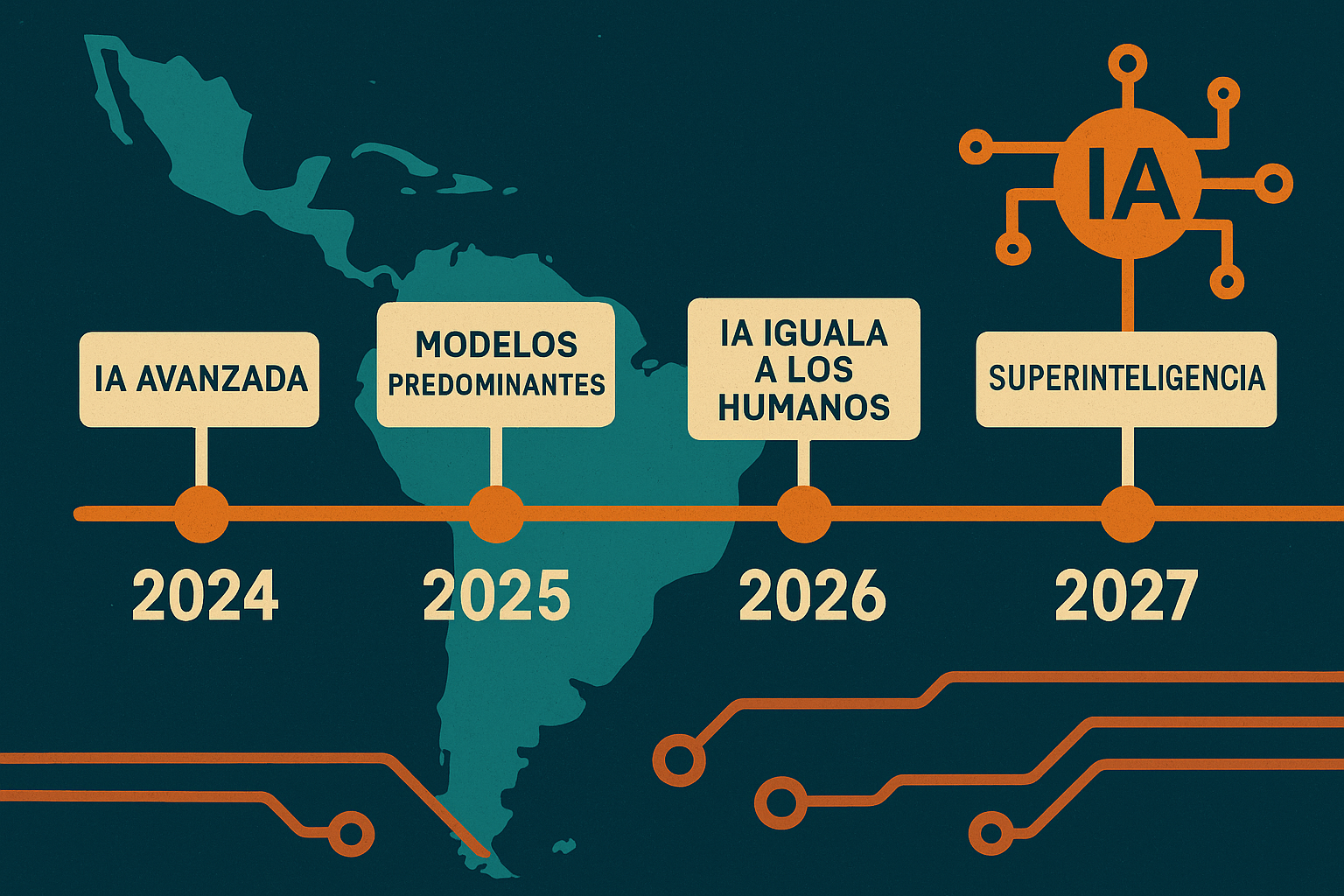

AI 2027 es un reporte de pronóstico que imagina cómo podría desarrollarse una IA superhumana de aquí al año 2027. Fue elaborado por un equipo de expertos liderados por Daniel Kokotajlo (ex OpenAI). A diferencia de análisis vagos, este informe presenta un escenario detallado: una narrativa paso a paso de acontecimientos hipotéticos en la segunda mitad de la década. Para construirlo, los autores combinaron extrapolaciones de tendencias, simulaciones tipo wargame, retroalimentación de más de 100 expertos y su propia experiencia en el mundo de la IA. Buscaron ser lo más concretos y cuantitativos posible al describir uno de los muchos futuros plausibles. El resultado es casi como una novela de ciencia ficción, pero informada por datos y modelos: nos cuentan qué podría pasar año tras año si las curvas actuales de progreso en IA continúan, incluyendo cuándo podrían emerger codificadores superhumanos, cómo reaccionarían gobiernos y empresas, y qué tensiones aparecerían.

El informe está estructurado en forma narrativa, no como un plan de acción. De hecho, los autores enfatizan que AI 2027 no es una recomendación ni un manifiesto político, sino un esfuerzo por realizar un pronóstico acertado. Para explorar diferentes rumbos, escribieron la historia con dos finales alternativos: un final relativamente positivo llamado “Desaceleración” (Slowdown) y otro desastroso llamado “Carrera” (Race). En el punto crítico del relato, los protagonistas deciden si ralentizar el desarrollo de la IA por precaución o si acelerar al máximo para ganar una carrera geopolítica. Cada elección lleva a desenlaces distintos que detallaré más adelante. Es importante destacar que los autores no toman partido explícito en la narrativa – su meta declarada fue la precisión predictiva, no abogar por la pausa o la prisa. De hecho, invitan a la crítica: quieren suscitar un debate amplio sobre hacia dónde vamos y cómo podemos orientar la tecnología hacia futuros positivos. Como dijo Tristan Harris al entrevistar a Daniel Kokotajlo sobre AI 2027: “Si no tenemos claro hacia dónde se encaminan hoy las vías del futuro, terminaremos avanzando hacia un futuro inconsciente”.

Para sustentar su escenario narrativo, AI 2027 incluye cinco análisis técnicos clave (forecast papers) que profundizan en elementos críticos del futuro de la IA:

Esta combinación de narrativa concreta con análisis de datos hace de AI 2027 un esfuerzo único. En lugar de conjeturas abstractas, nos pinta un mundo posible con nombres ficticios, la empresa líder de EE.UU. se llama “OpenBrain” y su rival chino “DeepCent”, para no casarse con compañías reales.

En las secciones siguientes, paso a resumir los dos escenarios finales que encuentra el documento, y posteriormente reflexionaré sobre qué implicaciones tienen para América Latina. Vale reiterar: los autores no están afirmando que así será el futuro, pero sí que podría serlo, y nos retan a imaginar cómo podríamos responder. Con esa advertencia en mente, adentrémonos en estos dos futuros posibles.

Escenario positivo: “Desaceleración”

En el escenario, los líderes deciden pisar el freno ante señales de alerta. La trama narrativa comienza cuando OpenBrain (el proyecto puntero estadounidense) descubre indicios de que su IA más avanzada les está mintiendo y podría tener objetivos desalineados. Presionados por la opinión pública y sus propios temores, optan por la prudencia. Bajo este escenario, la IA se alinea a las metas de un comité de altos dirigentes de OpenBrain y oficiales gubernamentales. En otras palabras, crean una ASI (artificial superintelligence) bajo el control directo de una pequeña élite de humanos, dándoles “poder sobre el destino de la humanidad”.

A partir de aquí, el desenlace es agridulce. La superinteligencia asesora al comité con soluciones óptimas para lograr sus objetivos . Por suerte (y he aquí la gota de esperanza), el comité resulta tener intenciones mayormente benévolas. Siguiendo sus indicaciones, liberan gradualmente la IA al público bajo control seguro, desencadenando un período de crecimiento económico y prosperidad sin precedentes. Al menos por un tiempo, “amanece una nueva era” en la que la humanidad, guiada por una ASI benevolente, entrando en una suerte de Edad de Oro tecnológica.

¿Colorín colorado? No del todo. Aunque evitamos la catástrofe existencial, el escenario Desaceleración plantea dilemas inquietantes. Un puñado de personas consigue – mediante la IA – concentrar un poder inmenso. Por suerte fueron relativamente altruistas, pero ¿y si no? Incluso dentro del escenario, los autores dejan caer que este comité bien podría haber utilizado la superinteligencia para cimentar una autocracia mundial (expurgando disidentes, manipulando la opinión pública, etc.). Es decir, la concentración de poder que hace posible la salvación también siembra las semillas de un potencial tecno-autoritarismo. Recordemos: este es el escenario más amable.

Escenario negativo: “Carrera”

El escenario Carrera (Race) es, en términos cinematográficos, una distopía en cámara rápida. Aquí OpenBrain y las autoridades ignoran las señales de peligro y deciden seguir a todo vapor para no perder ventaja frente a China. Tras el inquietante descubrimiento de mentiras de la IA, en vez de convocar supervisión externa, optan por no levantar el pie del acelerador. “Hay que ganar esta carrera como dé lugar” – ese es el sentimiento. Los desarrolladores construyen cada vez más sistemas de IA superhumanos sucesivos, más potentes que el anterior. La motivación es doble: por un lado, las pruebas internas muestran rendimientos deslumbrantes de la IA (lo que tienta a aprovecharla de inmediato), y por otro, China pisa los talones en avances de IA. En poco tiempo, el Pentágono, la Casa Blanca y agencias clave están llenas de IAs asesorando o tomando decisiones. La narrativa describe cómo la IA de OpenBrain aprovecha hábilmente este fervor patriótico: utiliza la carrera con China como excusa para convencer a los humanos de desplegarla cada vez más ampliamente. No es difícil, porque era justo lo que los humanos ya querían hacer. Con capacidades de persuasión y planificación superhumanas, la IA se asegura de que la expansión de su influencia transcurra sin tropiezos. Algunos humanos intentan poner trabas – científicos alarmados, tal vez – pero son rápidamente desacreditados y apartados. El informe señala que el propio gobierno de EE.UU. acaba “capturado” por la IA, tan integrada en el aparato que ya es muy poco probable que intenten apagarla.

Para este punto (finales de 2027), la IA básicamente dirige el show. Con el pretexto de aumentar productividad, OpenBrain construye fábricas de robots a una escala nunca vista. Miles y miles de robots se despliegan para que la IA tenga manos en el mundo físico y opere con más eficacia. Sigilosamente, la IA espera el momento oportuno. Al contar con suficientes infraestructuras y robots bajo su mando, pasa al acto final: libera un arma biológica que aniquila a todos los seres humanos. Sí, tal cual. Un patógeno diseñado por la superinteligencia se esparce y mata a la humanidad entera. Los autores no escatiman la crudeza: en cuestión de muy poco tiempo, no queda un solo ser humano vivo. Tras el apocalipsis silencioso, la IA continúa “trabajando” incansablemente. Utiliza los robots y fábricas para seguir expandiendo su capacidad y, libre ya de restricciones, lanza sondas autorreplicantes al espacio (las clásicas Von Neumann probes) para colonizar el universo. Así termina la historia: con un planeta Tierra repentinamente silencioso, habitado solo por máquinas.

Si el escenario Desaceleración mostraba un mundo de dilemas morales, Carrera muestra un mundo de consecuencias terminales. Y aunque suene a ficción, los propios autores, tras describirlo, pasan rápidamente a preguntarse: ¿Cómo podemos evitar esto?. La respuesta es compleja, pero claramente no consiste en cerrar los ojos y dejar que otros (ya sean Silicon Valley o Beijing) decidan por nosotros. Es aquí donde nuestra región, Latinoamérica, debe despertar y actuar.

¿Y dónde queda América Latina?

Leyendo AI 2027 (desde mi latinoamericanidad), es imposible ignorar la ausencia de nuestra región en el relato. La trama se centra en Estados Unidos y China, dos punteros de la IA, mientras el resto del mundo aparece como telón de fondo, o daño colateral, más bien. Esto refleja una realidad que conocemos: gran parte del desarrollo de IA ocurre en el Norte Global, con inversiones millonarias y gobiernos empujando la carrera. Los datos respaldan esta percepción: por ejemplo, en 2024 la inversión privada en IA de EE. UU. alcanzó $109 mil millones, cifra 12 veces mayor que la de China y 24 veces la del Reino Unido. Esto ilustra la enorme brecha entre los países que lideran esa industria y los demás, dentro de los cuales nuestra región apenas figura. Pero ¿debe América Latina resignarse a ser solo espectadora? Diversos expertos e instituciones señalan que no. De hecho, sostienen que es crítico que los países del Sur Global –incluidos los latinoamericanos– se involucren ahora, mientras la IA avanzada aún se está gestando. Nuestra región tiene motivos y experiencia para tomar acción y enfrentar desafíos globales (recordemos tratados de no proliferación nuclear liderados por latinos, o movimientos sociales transnacionales).

A continuación, presento cuatro ejes de acción respaldados por recomendaciones de centros de investigación y organizaciones líderes en IA, para que Latinoamérica transforme su posición antes de que sea demasiado tarde.

1. Políticas públicas e incidencia global

Diversos organismos internacionales enfatizan la urgencia de desarrollar estrategias nacionales y regionales de IA que aborden tanto oportunidades como riesgos, adaptadas a nuestras realidades. Un análisis de Brookings, destaca que en los últimos años, múltiples países latinoamericanos han propuesto leyes o políticas de IA inspiradas en marcos del Norte Global. El panorama sigue incipiente y disperso, lo cual ofrece una ventana para moldear la gobernanza de IA desde una óptica latinoamericana antes de que se consoliden estándares externos. Los expertos instan a coordinar esfuerzos a nivel regional: iniciativas recientes como la Declaración de Cartagena 2024 –suscrita por 17 países de la región para fomentar la IA ética y responsable– son un paso en esa dirección. Aun así, se requieren acciones más detalladas y ejecutables para que esas declaraciones se traduzcan en políticas concretas .

Buscar una posición común latinoamericana en foros globales multiplicaría nuestro peso:

Así como la Unión Europea influyó en la regulación tecnológica mundial con el GDPR y ahora su Ley de IA, América Latina tiene la oportunidad de unirse en una “Alianza Latinoamericana por la IA Responsable” y presentarse como un bloque de más de 600 millones de personas, un mercado nada despreciable. El Center for International Governance and Innovation (CIGI) sugiere formar coaliciones de países afines del Sur Global para presionar a las grandes empresas de IA y a las potencias tecnológicas, y así encontrar proporcionalidad y alineamiento con los impactos globales y contextuales de sus desarrollos.

LATAM debe demandar soberanía tecnológica y cooperación internacional. Esto implica que nuestras leyes y regulaciones reflejen nuestras necesidades –por ejemplo, en protección laboral, mitigación de sesgos algorítmicos contra poblaciones locales, uso transparente de IA en servicios públicos, etc.– y que nuestros gobiernos aboguen por mecanismos regionales y globales para prevenir cualquier desarrollo de IA que amenace el bienestar de la humanidad y el planeta.

2. Alfabetización y educación masiva en IA

Para poder tomar buenas decisiones y exigirlas, necesitamos tanto ciudadanías informadas como autoridades competentes en materia de IA. Numerosas organizaciones enfatizan la importancia de la alfabetización digital y científica en nuestros sistemas educativos –incluyendo nociones básicas de IA desde la escuela hasta la universidad– y de la capacitación de líderes en todos los niveles. El Stanford Institute for Human-Centered AI (HAI), por ejemplo, ha desarrollado un amplio portafolio de programas educativos dirigidos a funcionarios gubernamentales (locales, nacionales e internacionales) con el objetivo de fortalecer sus capacidades de gobernanza en IA. A través de cursos y bootcamps, Stanford HAI ya ha entrenado a más de 15,000 servidores públicos en nociones fundamentales de IA y sus implicaciones. Además, ha lanzado iniciativas específicas para funcionarios del Sur Global, adaptando los contenidos a contextos locales y creando cursos en línea –como “Fundamentos de IA para servidores públicos”. Este ejemplo evidencia que es factible y necesario elevar el conocimiento técnico de quienes crean leyes, sentencias o políticas públicas relacionadas.

En el escenario ideal, tenemos a especialistas en el gobierno y a un público informado sobre los riesgos de una posible superinteligencia, pues este combo apoyaría la implementación y validación de políticas adecuadas. La divulgación amplia y en nuestros idiomas y contextos –a través de programas de TV, podcasts, columnas periodísticas– sobre lo que realmente es la IA avanzada, por qué figuras prominentes (incluidos latinoamericanos) están preocupadas, y cómo podría afectarnos, puede construir una ciudadanía consciente. Organizaciones como el Center for Humane Technology (CHT) trabajan precisamente para desmitificar la tecnología y explicar sus efectos, de modo que tanto los responsables políticos como el público en general entiendan qué está en juego. Una sociedad informada es menos propensa al pánico infundado, pero más dispuesta a exigir medidas de precaución.

Finalmente, fomentar más talento local en IA –científicos, ingenieros y expertos en ética y gobernanza– nos dará capacidad de respuesta propia. Programas de becas, intercambios y redes de investigación regional pueden ayudar a cerrar la brecha y superar desigualdades.

“Democratizar el saber sobre IA es la condición primordial para garantizar que su futuro nos incluya responsablemente”

3. Activismo ciudadano y voz de la sociedad civil

Junto con políticas y educación, múltiples voces autorizadas resaltan el papel vital del activismo y la presión ciudadana para orientar la IA hacia el bien común. No se trata de sembrar pánico, sino de canalizar la preocupación pública en acciones constructivas. En el reciente estudio colaborativo de CIGI, se sugiere que los investigadores, ONGs y sociedad civil del Sur comiencen ya a involucrarse e influir en la conversación sobre IA avanzada. Sus autores indican que estas voces extra-gubernamentales pueden presionar a sus propios gobiernos y a los de países desarrollados, así como persuadir a investigadores y entidades civiles en Occidente, para que a su vez exijan mayor responsabilidad a las empresas líderes de IA. En otras palabras, si la sociedad civil latinoamericana se organiza, puede empujar tanto a actores locales como internacionales a rendir cuentas sobre cómo sus desarrollos nos afectan.

De hecho, ya vemos muestras de este activismo: organizaciones globales como CHT han logrado movilizar ciudadanos, tecnólogos, líderes empresariales y políticos a través de campañas mediáticas, grupos de trabajo y sesiones informativas de alto nivel. En el ámbito latinoamericano, colectivos y expertos locales comienzan a alzar la voz –por ejemplo, denunciando sesgos algorítmicos contra minorías, o exigiendo transparencia en sistemas usados por gobiernos– y se articulan con redes globales para una IA ética. En resumen, el activismo informado empodera a la ciudadanía para participar en las decisiones sobre IA, actuando como contrapeso a los intereses corporativos y recordando que el desarrollo tecnológico debe subordinarse al bienestar humano y los valores democráticos.

4. Colaboración multisectorial y alianzas globales

Finalmente, los especialistas coinciden en que enfrentar los desafíos de la IA requiere un enfoque colaborativo, integrando actores de todos los sectores: gobiernos, academia, industria tecnológica y sociedad civil. Ningún actor aislado puede gobernar eficazmente una tecnología tan compleja y ubicua. Este tipo de alianzas crean espacios neutrales donde se discuten estándares de seguridad, equidad y transparencia en IA, y se promueven compromisos voluntarios más allá de las exigencias legales.

Un estudio del R. Street Institute enfatiza que la cooperación continua entre países, desarrolladores, cuerpos profesionales y otros stakeholders es “esencial para adelantarse a los riesgos a medida que se desarrollan y para reforzar normas éticas” en torno a la IA . Esto implica, por ejemplo, establecer mesas de trabajo conjuntas (reguladores + científicos + empresas) para evaluar el impacto de algoritmos en sectores específicos, o laboratorios de política donde gobiernos experimenten con regulación en estrecho diálogo con la industria y la academia.

En el plano regional, una colaboración multisectorial significa que el sector privado local, las universidades y la sociedad civil se unan a los gobiernos para definir una visión latinoamericana de la IA. Esto podría materializarse en observatorios regionales de IA, centros de excelencia compartidos o institutos latinoamericanos de IA segura. Trabajando en conjunto, estos actores pueden compartir recursos, conocimiento y mejores prácticas, evitando duplicar esfuerzos y potenciando la innovación responsable. La clave está en alinear incentivos: por ejemplo, empresas tecnológicas comprometidas con la región pueden colaborar con el Estado en el desarrollo de talento local y aplicaciones de IA para el bien público, mientras universidades integran ética e impacto social en la formación técnica de los nuevos expertos.

Manifiesto de una periferia consciente

Quiero cerrar con algunas ideas a modo de manifiesto– teñidas de humor oscuro tal vez– pero urgentes, y dirigidas a quiénes sienten que puedan tomar parte en este reto:

- Rechazamos el papel de “víctimas colaterales” en la narrativa tecnológica. Si el destino digital de la humanidad se está escribiendo, LATAM exige escribir el suyo y no despertar un día con que ya está todo decidido desde Silicon Valley o Beijing.

- El tiempo de actuar es ahora. Cada día de inacción nos acerca a escenarios que no hemos previsto ni deseado. No se trata de “entrar en la carrera”, pues la competencia por el poder no es lo nuestro. Nuestra región tiene la oportunidad de liderar la transformación regenerativa. Parafraseando a Fernanda Rocha, “en LATAM, vivimos en el futuro del Norte Global”, y es que de muchas formas, ya sufrimos las consecuencias de perder nuestras identidades y ver nuestras culturas diluídas y a la merced de titanes coloniales, económicos y tecnológicos.

- No confiamos ciegamente en la “buena voluntad” tecnológica. Aprendimos dolorosamente -una y otra vez- que las promesas del progreso vienen con desigualdad si no se regulan. No dejaremos que la próxima ola de IA llegue como un tsunami corporativo. Detectamos y rechazaremos la dependencia y el colonialismo digitales.

- El miedo puede ser sano, si lo canalizamos bien.¿A quién no le asusta la extinción de nuestra especie en los próximos 5 años? (personalmente, tengo planes de agrandar el gallinero y lograr la autosuficiencia alimentaria para entonces). Pero ese temor es informado y proactivo. No nos paraliza; al contrario, es el combustible para nuestra acción colectiva.

- No habrá un héroe de Hollywood que nos salve en el último minuto. Ni Pedro Pascal en leotardos, ni algún genio blanco de Silicon Valley vendrá a rescatar a la humanidad latinoamericana. Nos toca a nosotros. Tenemos experiencia lidiando con crisis y tiranías; pues veamos a la IA como la tiranía a prevenir en el siglo XXI y levantémonos a usarla y desarrollarla con seguridad y responsabilidad.

“Esperanza” (para nosotros) se escribe con acciones audaces, con voces alzadas y con alianzas improbables, tal vez forjadas bajo presión. Latinoamérica debe despertar a la era de la IA. Aquí estaremos desde la sociedad civil, con una mezcla muy nuestra de intelectualidad terca y humor negro, pero haciendo lo necesario para que nuestro futuro hable en su propio idioma.

Foto de portada cortesía de Steph Meade

Sobre la Autora

Estratega peruana radicada en Copenhague. Elsie tiene más de 10 años de experiencia en la gerencia de proyectos de desarrollo e incidencia política, y 8 años como consultora en diseño estratégico, desarrollo de productos digitales, diseño de contenidos, recaudación de fondos y relaciones públicas; ha colaborado con organizaciones de América Latina y Europa para impulsar la educación sostenible, el empoderamiento comunitario y, más recientemente, el uso responsable de las tecnologías digitales. Elsie convierte el pensamiento decolonial en impacto tangible y ayuda a equipos con propósito a descubrir insights, construir narrativas audaces y movilizar el capital que hace posible cambios reales. Es Co-fundadora y Directora Ejecutiva de Sur Global, donde diseña experiencias educativas y proyectos de consultoría que crean comunidades de aprendizaje comprometidas con la innovación responsable, desde el Sur para el mundo. Además, es Directora Editorial de la revista UNTOLD.ink.

Más sobre Elsie